IBMのConfluent買収 — リアルタイムデータがAIエージェントの燃料になる時代

IBMがConfluentを110億ドルで買収し、リアルタイムデータストリーミングがAIエージェントの中核インフラとして浮上しました。CTO視点で本買収の意義と対応戦略を分析します。

概要

2026年3月17日、IBMがデータストリーミングプラットフォーム企業Confluentを110億ドル(約1兆6,500億円)で買収完了しました。Fortune 500企業の40%以上が利用するConfluentのApache Kafkaベースプラットフォームが、IBMのwatsonxエコシステムに統合されたことで、リアルタイムデータストリーミングがエンタープライズAIエージェントの中核インフラとして確立されました。

今回の買収は単なるM&Aを超え、AI時代のデータアーキテクチャがどの方向に進化しているかを明確に示しています。Engineering ManagerからCTOまで、エンジニアリングリーダーがこの変化をどう読み解くべきかを分析します。

なぜリアルタイムデータなのか — 「Data Latency Gap」問題

従来のAIシステムの限界

ほとんどのエンタープライズAIシステムはバッチ処理(Batch Processing)ベースで運用されています。データを収集し、ETL(Extract, Transform, Load)パイプラインで整形した後、モデルに投入する方式です。

[運用DB] → [ETLパイプライン] → [データウェアハウス] → [AIモデル]

数時間〜数日の遅延この構造ではAIモデルが参照するデータは常に「過去のスナップショット」です。リアルタイムに変化する市場状況、顧客行動、システム状態を反映できません。

AIエージェントが求めるもの

2026年のAIエージェントは、単に質問に答えるチャットボットではありません。自律的に判断し、行動し、結果を確認する能動的なシステムです。このようなエージェントが「昨日のデータ」に基づいて意思決定を行えば、その結果は信頼できません。

graph TD

subgraph 従来方式

A["バッチデータ<br/>(数時間前)"] --> B["AIモデル"]

B --> C["レスポンス生成"]

end

subgraph リアルタイム方式

D["ライブストリーム<br/>(ミリ秒単位)"] --> E["AIエージェント"]

E --> F["自律判断"]

F --> G["即時アクション"]

G -.-> D

endIBMがConfluentを買収した核心的な理由が、まさにこの「Data Latency Gap」を解消するためです。

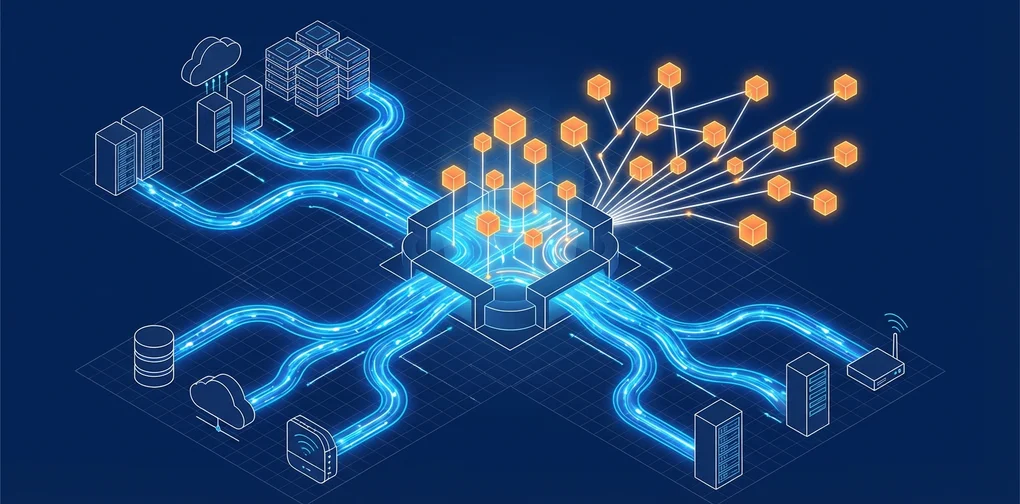

IBM + Confluent 統合アーキテクチャ

主要な統合ポイント

IBMのRob Thomas SVPは今回の買収を「Agentic AIパズルの最後のピース」と表現しました。具体的な統合構造は以下の通りです。

graph TD

subgraph データソース

A["運用DB"] ~~~ B["IoTセンサー"] ~~~ C["SaaSアプリ"]

end

subgraph Confluent

D["Apache Kafka<br/>イベントストリーミング"]

E["Tableflow<br/>ストリーム→テーブル変換"]

end

subgraph IBM watsonx

F["watsonx.data<br/>レイクハウス"]

G["watsonx.ai<br/>AIモデル"]

H["watsonx.governance<br/>ガバナンス"]

end

subgraph エージェントレイヤー

I["AIエージェント<br/>自律的意思決定"]

end

A --> D

B --> D

C --> D

D --> E

E --> F

F --> G

G --> I

H -.-> G

H -.-> I

I -.-> Dゼロコピーデータシェアリング

最も注目すべき技術はConfluentのTableflowとwatsonx.dataの統合です。

従来はKafkaのストリーミングデータをAIモデルで使用するには、別途のETLプロセスを経る必要がありました。Tableflowを活用すれば、Kafkaストリームをまるでデータベーステーブルのように直接クエリできます。

# 従来: ETLパイプラインが必要

raw_data = kafka_consumer.poll()

transformed = etl_pipeline.transform(raw_data)

warehouse.insert(transformed)

result = ai_model.predict(warehouse.query("SELECT * FROM orders"))

# Tableflow統合: ゼロコピー直接クエリ

result = ai_model.predict(

watsonx_data.query("SELECT * FROM kafka_stream.orders")

)この方式はETLコストを排除し、データ遅延をミリ秒単位に短縮し、AIエージェントが常に最新データに基づいて行動できるようにします。

CTO/VPoE視点の戦略的示唆

1. 「Live Agentic AI」パラダイムの台頭

今回の買収は業界全体の方向性を示しています。AIエージェントが静的データではなくライブイベントストリームに基づいて動作する「Live Agentic AI」パラダイムが本格化しています。

実務への影響:

- 既存のバッチベースMLパイプラインをストリーミングアーキテクチャへの転換検討が必要

- データエンジニアリングチームにKafka/イベントストリーミングのケイパビリティ確保が必要

- AIエージェントの意思決定品質がデータ鮮度(Data Freshness)に直結

2. ガバナンスとリネージの重要性

リアルタイムデータがAIエージェントの意思決定に直接影響を与える場合、データガバナンスの重要性が急激に高まります。

graph TD

A["ライブデータストリーム"] --> B{"ガバナンスゲート"}

B -->|"承認"| C["AIエージェント"]

B -->|"拒否"| D["監査ログ"]

C --> E["自律アクション"]

E --> F["リネージ追跡"]

F -.-> Dチェックポイント:

- データリネージ(lineage)追跡システムの構築

- AIエージェントの意思決定根拠データを監査可能な状態で保存

- ポリシーベースアクセスコントロール(Policy-Based Access Control)の適用

3. ベンダーロックイン vs オープンソース戦略

IBMの統合プラットフォームは強力ですが、ベンダーロックインのリスクを伴います。CTOとして検討すべき代替戦略は以下の通りです。

| アプローチ | メリット | デメリット |

|---|---|---|

| IBMフルスタック(Confluent + watsonx) | 統合管理、ガバナンス一体型 | 高コスト、ベンダーロックイン |

| OSS構成(Kafka + 自社AI) | 柔軟性、コスト削減 | 統合の複雑さ、ガバナンス自前構築が必要 |

| ハイブリッド(Confluent Cloud + マルチAI) | データレイヤー統一、AI柔軟性 | 複雑なアーキテクチャ管理 |

4. 組織ケイパビリティの転換

今回の変化は技術だけの問題ではありません。組織構造とケイパビリティの転換も必要です。

データエンジニアリングチームの役割変化:

- バッチETL運用 → イベントストリーミングアーキテクチャ設計

- データウェアハウス管理 → リアルタイムデータパイプライン運用

- 静的レポーティング → AIエージェント向けデータフィード最適化

AI/MLエンジニアの役割拡大:

- モデル学習/デプロイ → エージェントオーケストレーション

- オフライン評価 → リアルタイムモニタリングおよびフィードバックループ設計

実務適用: 最初の一歩

IBM-Confluent規模のインフラがなくても、リアルタイムデータ + AIエージェントパターンは小規模でも適用可能です。

最小構成の例

# docker-compose.yml(最小リアルタイムAIエージェントスタック)

services:

kafka:

image: confluentinc/cp-kafka:latest

ports:

- "9092:9092"

agent-worker:

build: ./agent

environment:

- KAFKA_BOOTSTRAP_SERVERS=kafka:9092

- LLM_API_KEY=${LLM_API_KEY}

depends_on:

- kafka

monitoring:

image: grafana/grafana:latest

ports:

- "3000:3000"イベントドリブンAIエージェントパターン

from confluent_kafka import Consumer

import anthropic

client = anthropic.Anthropic()

consumer = Consumer({

'bootstrap.servers': 'localhost:9092',

'group.id': 'ai-agent-group',

'auto.offset.reset': 'latest'

})

consumer.subscribe(['business-events'])

while True:

msg = consumer.poll(1.0)

if msg is None:

continue

event = json.loads(msg.value())

# AIエージェントがリアルタイムイベントに基づいて判断

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=1024,

messages=[{

"role": "user",

"content": f"次のビジネスイベントを分析し、対応策を提案してください: {event}"

}]

)

# エージェントの判断結果を再びイベントとして発行

producer.produce(

'agent-decisions',

json.dumps({"event": event, "decision": response.content})

)まとめ

IBMのConfluent買収は、「AIエージェント時代のデータインフラはリアルタイムでなければならない」というメッセージを明確に伝えています。110億ドルという金額は、リアルタイムデータストリーミングが単なる技術トレンドではなく、エンタープライズAIの基盤インフラであることを証明しています。

エンジニアリングリーダーとして今すぐ始められるアクション:

- 現在のデータアーキテクチャの遅延時間の監査 — AIエージェントが参照するデータがどれほど「新鮮」かを測定

- イベントストリーミングPoCの実施 — 最も時間に敏感なワークフローにKafkaベースストリーミングのパイロットを適用

- ガバナンスフレームワークの設計 — リアルタイムデータがAIの意思決定に投入される前にポリシーおよび監査体制を整備

- チームケイパビリティのロードマップ策定 — データエンジニアリング + AIエンジニアリングのクロスファンクショナルなスキル開発計画

バッチからストリーミングへ、チャットボットからエージェントへ — データとAIの関係が根本的に再定義されています。

参考資料

他の言語で読む

- 🇰🇷 한국어

- 🇯🇵 日本語(現在のページ)

- 🇺🇸 English

- 🇨🇳 中文

この記事は役に立ちましたか?

より良いコンテンツを作成するための力になります。コーヒー一杯で応援してください!☕