Claude Opus 4.8 Dynamic Workflows 実践分析

1,000個のサブエージェントとFast Modeがエージェント開発ワークフローをどう変えるか。公式ドキュメントと実際の事例をもとに、アーキテクチャ・コスト・限界を率直に整理した。

latest

1,000個のサブエージェントとFast Modeがエージェント開発ワークフローをどう変えるか。公式ドキュメントと実際の事例をもとに、アーキテクチャ・コスト・限界を率直に整理した。

note

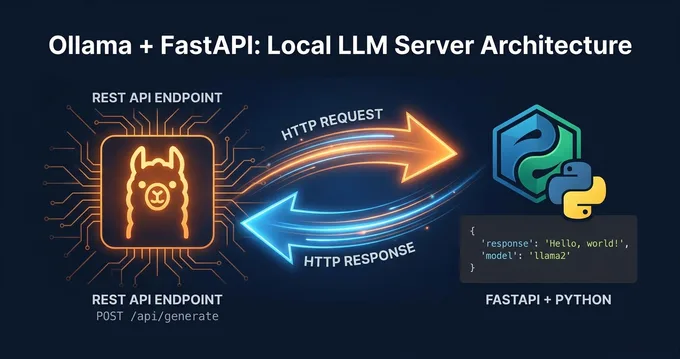

note Ollama REST APIをFastAPIでラッピングし、SSEストリーミング・ヘルスチェック・Docker Composeデプロイを備えたプロダクション用ローカルLLMサーバーを段階的に構築する実践ガイド。Llama 3.2やMistralなど複数モデルの実行ログとAPIテスト例も掲載しています。

note

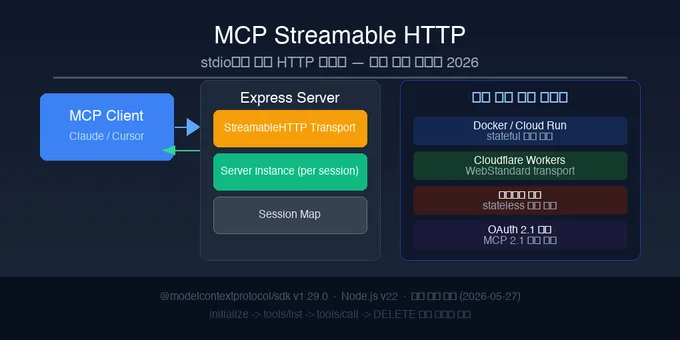

note MCP Streamable HTTPトランスポートでstdioサーバーをリモート配備可能なHTTPサービスへ移行する実践ガイド。@modelcontextprotocol/sdk v1.29.0基準でstateful・statelessモードの実装とDocker・Cloudflare配備パターンを実験ログとともに解説します。

note

note Vitest 4.1.7ベースでJestプロジェクトをステップごとに移行する実践ガイド。インストールから設定切り替え・コード変換パターン・安定Browser Mode・新マッチャー(toSatisfy, toBeOneOf)まで、実際のサンドボックスで検証した全結果をまとめた決定版の完全移行ガイド。

note

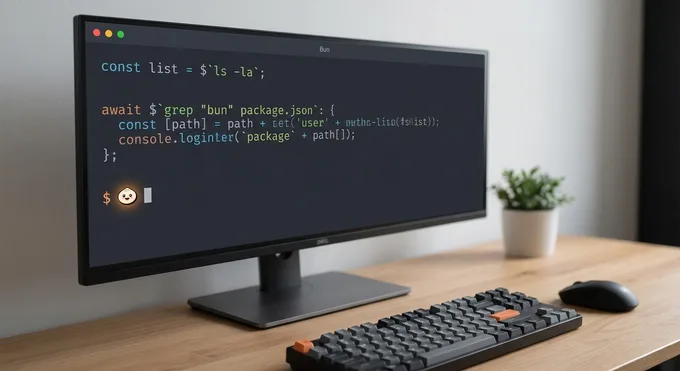

note Bun 1.3.14で実際に実験したBun Shell完全ガイド。$テンプレートリテラル、.nothrow()エラー処理、Promise.all並列化、macOS echoの罠まで実行ログ付きでまとめた。zxとの実質的な違いやプロダクション配備時の注意点も解説。

note

note 2026年5月の実測データ。Gemini 2.5 Flash-Lite(65 TPS)、2.5 Flash、2.5 Pro、3.5 Flashを同条件で比較。チャットボット・コードレビュー・RAGシナリオ別月次コスト計算と、どのプロジェクトにどのモデルを使うべきかの判断基準を整理する。