Claude Opus 4.8 Dynamic Workflows 실전 분석

1,000개 서브에이전트와 Fast Mode가 에이전트 개발 워크플로우를 어떻게 바꾸는가. 공식 문서와 실제 사례를 기준으로 아키텍처, 비용, 한계를 솔직하게 정리했다.

latest

1,000개 서브에이전트와 Fast Mode가 에이전트 개발 워크플로우를 어떻게 바꾸는가. 공식 문서와 실제 사례를 기준으로 아키텍처, 비용, 한계를 솔직하게 정리했다.

note

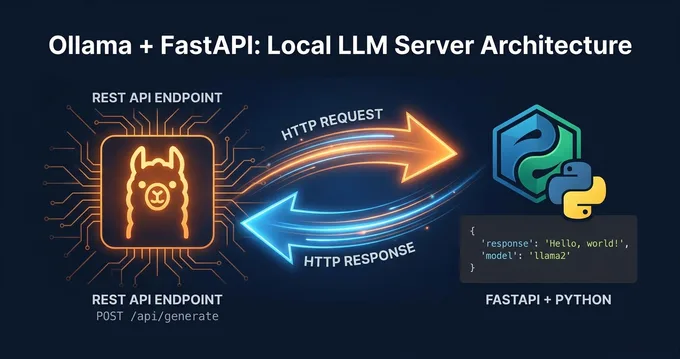

note Ollama REST API를 FastAPI로 래핑해 SSE 스트리밍·헬스 체크·Docker 컨테이너 배포까지 갖춘 프로덕션급 로컬 LLM 서버를 단계별로 구축합니다. Llama 3.2, Mistral 등 주요 모델 실행 로그와 API 테스트 예제를 포함한 실전 가이드.

note

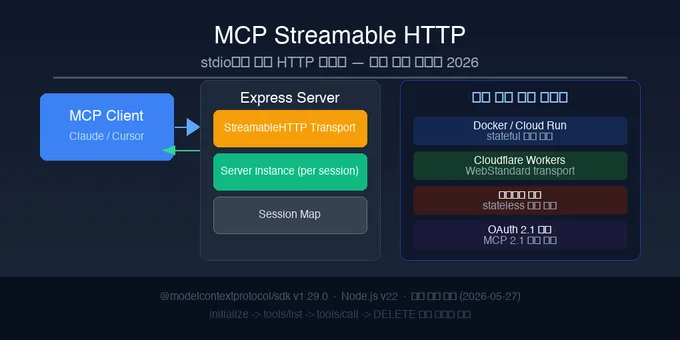

note MCP Streamable HTTP 트랜스포트로 stdio 서버를 원격 배포 가능한 HTTP 서비스로 전환하는 실전 가이드. @modelcontextprotocol/sdk v1.29.0 기준 stateful·stateless 모드 구현과 Docker·Cloudflare 배포 패턴을 실험 로그와 함께 설명합니다.

note

note Vitest 4.1.7 기준으로 Jest 프로젝트를 단계별로 마이그레이션하는 실전 가이드. 설치, 설정 전환, jest→vitest 코드 변환 패턴, Browser Mode stable, 신규 매처(toSatisfy, toBeOneOf)까지 직접 실험한 결과를 담았다.

note

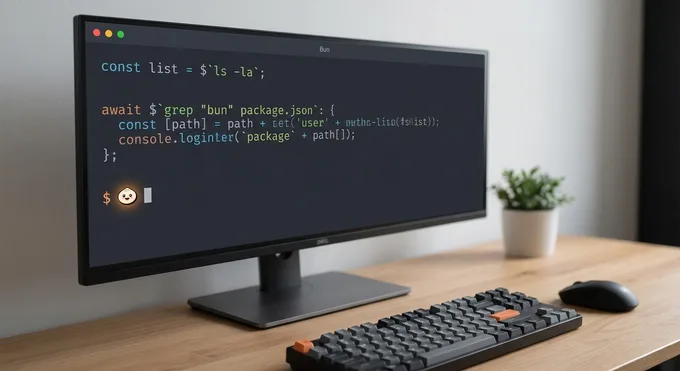

note Bun 1.3.14에서 직접 실험한 Bun Shell 완전 가이드. $ 템플릿 리터럴 기본 패턴, .nothrow() 에러 처리, Promise.all 병렬화, macOS echo 함정까지 실제 출력 로그와 함께 정리했다. zx와의 실질적 차이점, 그리고 프로덕션 배포 시 주의사항도 포함.

note

note 2026년 5월 실측 데이터. Gemini 2.5 Flash-Lite(65 TPS), 2.5 Flash, 2.5 Pro, 3.5 Flash를 동일 조건에서 비교했다. 챗봇·코드리뷰·RAG 시나리오별 월 비용 계산과 어떤 프로젝트에 어느 모델을 써야 하는지 결정 기준을 정리한다.