Claude Code Review — 多智能体PR审查将代码审查率从16%提升至54%

全面解析Anthropic发布的Claude Code Review功能:并行多智能体架构、每PR平均$15〜25的成本结构,以及Engineering Manager在考虑采用时需要了解的一切

2026年3月9日,Anthropic在工程博客上低调发布的一则公告在业界引发了涟漪。Claude Code Code Review — 一项在每个拉取请求(PR)上自动部署多智能体团队来发现漏洞和安全问题的功能。

数字说明一切。在Anthropic内部测试中,收到实质性审查评论的PR比例从16%跃升至54%,仅凭这一个功能就实现了飞跃。本文将深入解析其工作原理、成本结构,以及Engineering Manager的采用决策框架。

为何是现在 — AI生成代码的爆炸式增长

2026年,随着AI编码工具的普及,团队生产的代码量急剧增加,但审查带宽却没有跟上。积极使用Claude Code的团队中,单个开发者一天提交数十次已不罕见。结果是大量PR在没有充分审查的情况下合并,AI引入的细微漏洞就这样直接进入了生产环境。

根据Anthropic的数据,在1,000行以上的大型PR中,Code Review平均发现7.5个问题。开发者将建议标记为”错误”的比例不足1%。

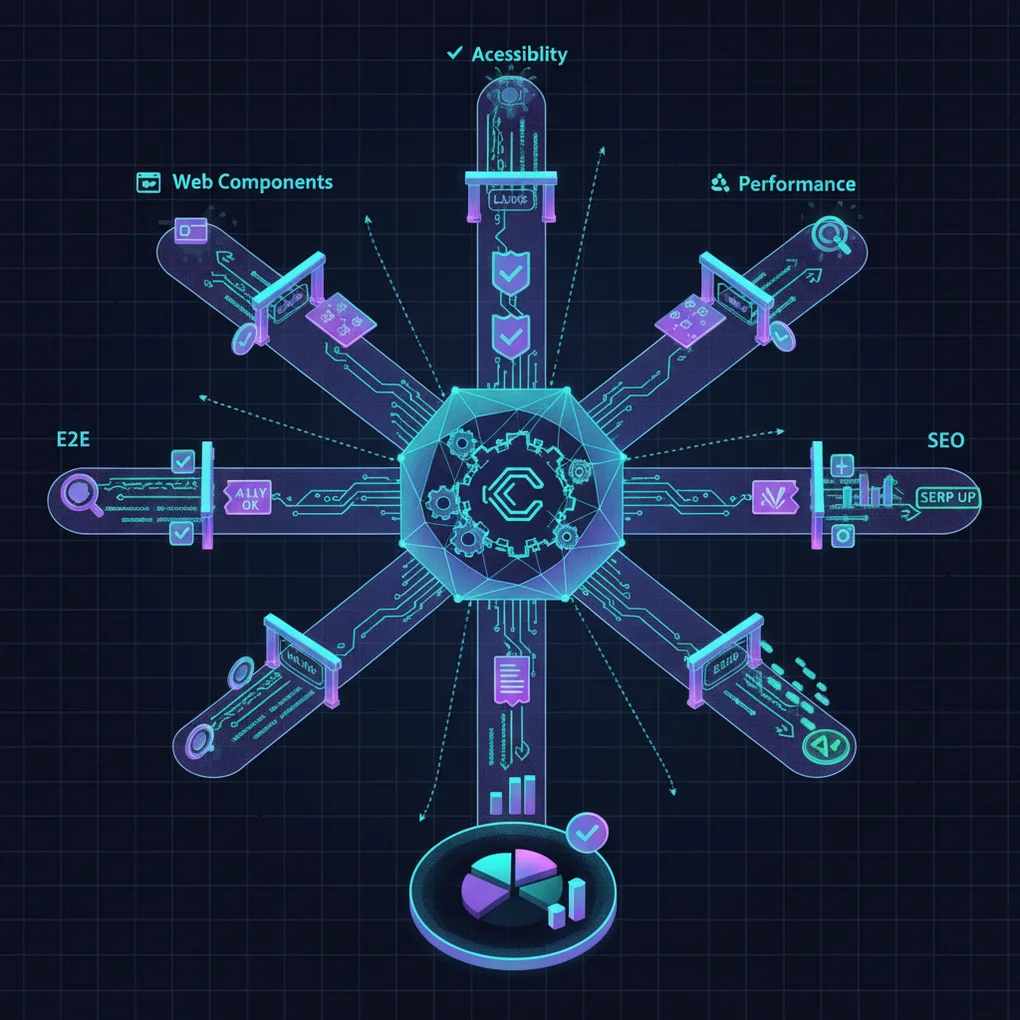

工作原理 — 并行智能体团队

与让单一模型阅读整个PR的传统AI审查工具不同,Claude Code Review以真正的团队结构运作:

接收PR

│

├── 智能体A: 逻辑错误检测

├── 智能体B: 安全漏洞分析

├── 智能体C: 性能回归检查

└── 智能体D: 测试覆盖率审查

│

└── 聚合智能体: 去重 + 按严重程度排序

│

└── 最终审查评论 (PR概述 + 内联注释)智能体并行运行,聚合智能体整合结果,去除重复项并按严重程度排序。开发者首先看到最重要的问题。

每次审查的平均耗时约20分钟。这是一个明确的设计哲学:深度优于速度。

成本结构

| 项目 | 内容 |

|---|---|

| 计费方式 | 基于Token |

| 平均成本 | 每PR $15〜25 |

| 大型PR(1,000行以上) | 可能超过$25 |

| 小型PR(50行以下) | $5以下 |

| 成本上限控制 | 可设置月度上限 |

| 仓库级别启用 | 支持 |

关键在于成本控制手段充分完善。可以设置月度支出上限,按仓库开关Code Review,并通过分析仪表板追踪使用情况。

如果一名开发者的代码审查时间每小时成本为$50,那么为每个PR花费$20来减少这段时间,对于许多团队来说在经济上是合理的。

实际性能指标

Anthropic公布的内部数据:

- 大型PR(1,000行以上): 84%发现问题,平均7.5个

- 小型PR(50行以下): 31%发现问题,平均0.5个

- 误报率: 开发者将建议标记为”错误”的比例不足1%

- 审查覆盖率: 收到实质性审查评论的PR 16% → 54%

不足1%的误报率令人印象深刻。传统静态分析工具的误报率动辄达到两位数,让开发者对警告产生麻木。这里的实际使用体验应该会大相径庭。

Engineering Manager需要了解的内容

何时采用最有意义

高效益场景:

- 积极使用AI编码工具的团队:代码量增加但审查带宽不足

- 安全敏感代码库:金融、医疗、认证相关PR需要额外验证层

- 频繁出现大型PR(1,000行以上):人类审查者最容易遗漏的领域

效益较低的场景:

- 团队规模小且审查文化强的情况(人类审查者已经足够)

- 以小型PR为主的开发风格(即使$5以下累积也会增加成本)

成本效益计算方法

每日PR数 × 平均成本 × 工作日数 = 月度预估成本

示例:

- 团队规模:10人

- 每日平均PR:20个

- 平均成本:$20/PR

- 月成本:20 × $20 × 22天 = $8,800关键问题:避免一个生产环境漏洞的成本(调试 + 热修复部署 + 故障处理)是否超过$8,800?对大多数团队来说答案是肯定的。

推广策略

- 选择试点仓库:从代码复杂、大型PR频繁的核心仓库开始

- 设置月度预算上限:前1〜2个月控制在$500以下,了解使用模式

- 监控误报率:追踪开发者将建议标记为”错误”的比例

- 扩展:确认效果后推广至所有仓库

与现有工具的定位比较

| 工具 | 特性 | 与Claude Code Review的区别 |

|---|---|---|

| SonarQube/ESLint | 静态分析(基于规则) | 无上下文理解,仅应用规则 |

| Copilot PR Summary | 以摘要为主 | 描述变更,不发现漏洞 |

| GitHub Advanced Security | 安全扫描 | 对逻辑错误较弱 |

| Claude Code Review | 多智能体深度审查 | 对以上所有工具的补充 |

Claude Code Review不是要取代现有工具,而是作为补充工具定位。保留SonarQube,保留安全扫描,在此基础上添加语义分析层。

可用性与路线图

目前以Research Preview形式向Team和Enterprise计划用户提供,通过GitHub集成运行。GitLab支持计划在未来扩展。

作为Research Preview阶段,功能和定价在正式发布前可能会有调整。

总结

AI生成的代码由AI审查 — 这正在成为2026年工程实践的新现实。这不是完美的解决方案,但从16%跃升至54%的审查覆盖率是一个难以忽视的数字。

是否采用取决于团队的PR模式、代码复杂度,以及单个生产漏洞的成本。建议先在一个核心仓库进行试点,收集数据后再做决定。

参考资料:

阅读其他语言版本

- 🇰🇷 한국어

- 🇯🇵 日本語

- 🇺🇸 English

- 🇨🇳 中文(当前页面)

这篇文章有帮助吗?

您的支持能帮助我创作更好的内容。请我喝杯咖啡吧!☕