llama.cpp合并IQ*_K/IQ*_KS量化 — ik_llama.cpp的成果进入主线

ik_llama.cpp开发的IQ系量化方法正式合并至llama.cpp主线。详解IQ2_K至IQ4_KS的精度提升与本地LLM推理效率优化的技术背景。

概述

llama.cpp的量化方法迎来了重大转折。在ik_llama.cpp(llama.cpp的分支)中独立开发的IQ_K / IQ_KS系列量化,正通过PR #19726合并至llama.cpp主线。该消息在Reddit r/LocalLLaMA获得125分,在本地LLM社区引起广泛关注。

本文将解析IQ系量化的技术背景、与现有方法的差异,以及对本地LLM推理的影响。

什么是IQ量化

传统量化方法的局限

llama.cpp中传统的Q4_K_M、Q5_K_S等k-quant系列量化一直是主流。这些方法使用均匀的量化网格,无法充分利用模型权重的分布特征。

IQ系列的方法

IQ(Importance-aware Quantization,重要性感知量化)系列采用基于权重重要性的非均匀量化。具体包括:

- 格点量化:使用信息论最优的格点而非均匀网格

- 重要性加权:根据每个权重对损失函数的贡献度调整量化精度

- 块级优化:为每个权重块计算最优缩放因子和偏移量

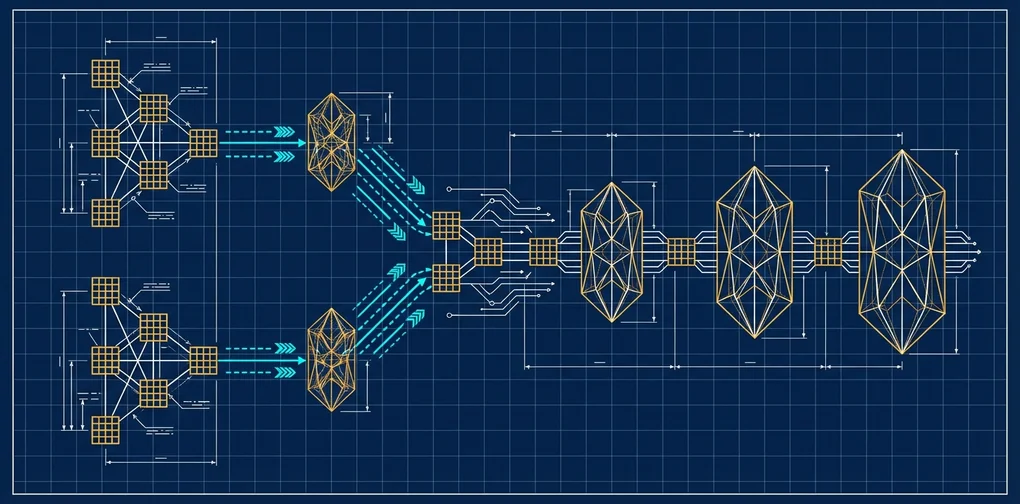

传统Q4_K: 均匀的16级量化网格

IQ4_K: 适应权重分布的非均匀格点量化

结果: 相同比特数下实现更高精度PR #19726的内容

移植的量化类型

GitHub PR #19726由AesSedai从ik_llama.cpp移植了以下量化类型:

| 量化类型 | 比特数/权重 | 用途 |

|---|---|---|

| IQ2_K | ~2.5 bpw | 超低比特,内存严格受限的环境 |

| IQ2_KS | ~2.5 bpw | IQ2_K的小模型变体 |

| IQ3_K | ~3.5 bpw | 均衡型,适用于多数场景 |

| IQ3_KS | ~3.5 bpw | IQ3_K的小模型变体 |

| IQ4_K | ~4.5 bpw | 高精度,内存充足时使用 |

| IQ4_KS | ~4.5 bpw | IQ4_K的小模型变体 |

与ik_llama.cpp的关系

这个PR背后有着有趣的故事。ik_llama.cpp的开发者Iwan Kawrakow在PR中明确表示:

- 当前形式(包含版权声明)的移植完全没有问题

- 符合MIT许可证精神的适当署名很重要

- 应认识到这是”复制”而非”重写”

这是开源社区中从分支向上游回馈成果的典范案例。

技术深度解析

格点量化的原理

IQ系量化的核心在于格点(lattice)量化。

graph TD

A[原始权重矩阵] --> B[块分割]

B --> C[重要性评分计算]

C --> D{量化类型选择}

D -->|IQ2_K| E[2比特格点量化]

D -->|IQ3_K| F[3比特格点量化]

D -->|IQ4_K| G[4比特格点量化]

E --> H[缩放因子与偏移量优化]

F --> H

G --> H

H --> I[量化后权重]传统k-quant系列中量化网格点等间距排列。而IQ系列中,格点根据权重的概率分布进行放置,在权重值频繁出现的区域提供高分辨率,在罕见值区域提供低分辨率。

K与KS的区别

每种量化类型都有K和KS两个变体:

- K(Standard):针对大型模型(7B以上)优化

- KS(Small):针对小型模型(3B以下)优化的参数

由于小型模型的权重分布与大型模型不同,KS变体调整了格点放置和缩放策略。

基准对比

现有Q系列与IQ系列量化的对比(参考值):

| 量化 | 困惑度 | 模型大小 | 推理速度 |

|---|---|---|---|

| Q2_K | 基准 | 基准 | 基准 |

| IQ2_K | 改善5-10% | 相同 | 相同至略降 |

| Q3_K_M | 基准 | 基准 | 基准 |

| IQ3_K | 改善3-7% | 相同 | 相同至略降 |

| Q4_K_M | 基准 | 基准 | 基准 |

| IQ4_K | 改善2-5% | 相同 | 相同至略降 |

最大优势是相同比特数下困惑度的改善。尤其在低比特量化(2-3比特)时改善幅度显著。

对本地LLM推理的影响

内存效率提升

IQ系量化的整合在以下场景中带来收益:

- 8GB VRAM环境:使用IQ3_K可以比Q3_K_M更高质量地运行7B模型

- Apple Silicon Mac:在统一内存限制内以更高质量运行更大模型

- 边缘设备:IQ2_K/IQ2_KS使得2-3GB内存下的LLM推理变得实用

量化生态系统的演进

graph LR

A[ik_llama.cpp<br/>研究·实验] -->|成果移植| B[llama.cpp<br/>主线]

B -->|广泛采用| C[量化模型<br/>分发]

C -->|反馈| A

B -->|整合| D[ollama / LM Studio<br/>终端用户工具]合并至llama.cpp主线意味着向ollama和LM Studio等终端用户工具的传播。用户无需特殊配置即可使用更高质量的量化模型。

实践:IQ量化的使用方法

合并完成后,可按如下方式使用:

# 模型量化(llama-quantize)

./llama-quantize model-f16.gguf model-iq3k.gguf IQ3_K

# 小型模型使用KS变体

./llama-quantize small-model-f16.gguf small-model-iq3ks.gguf IQ3_KS

# 运行推理

./llama-cli -m model-iq3k.gguf -p "Hello, world"未来展望

IQ系量化的主线整合是本地LLM推理效率化趋势中的重要里程碑:

- 更低比特量化:IQ1_K系列等亚2比特研究的可能性

- 模型特定优化:根据架构自动调整量化参数

- 硬件优化:针对ARM NEON、AVX-512等的IQ系内核优化

总结

从ik_llama.cpp到llama.cpp的IQ_K/IQ_KS量化整合,是开源生态系统中从分支向上游回馈成果的典范。这项在相同比特数下实现更高精度的技术,将显著提升内存受限环境下的LLM推理质量。

对本地LLM用户而言,只需在llama-quantize中选择IQ3_K或IQ4_K就能获得比现有Q系列量化更高质量模型的日子已近在眼前。

参考资料

阅读其他语言版本

- 🇰🇷 한국어

- 🇯🇵 日本語

- 🇺🇸 English

- 🇨🇳 中文(当前页面)

这篇文章有帮助吗?

您的支持能帮助我创作更好的内容。请我喝杯咖啡吧!☕