30美元收音机 + 本地AI = 无需互联网的智能家居 — 边缘AI实用案例

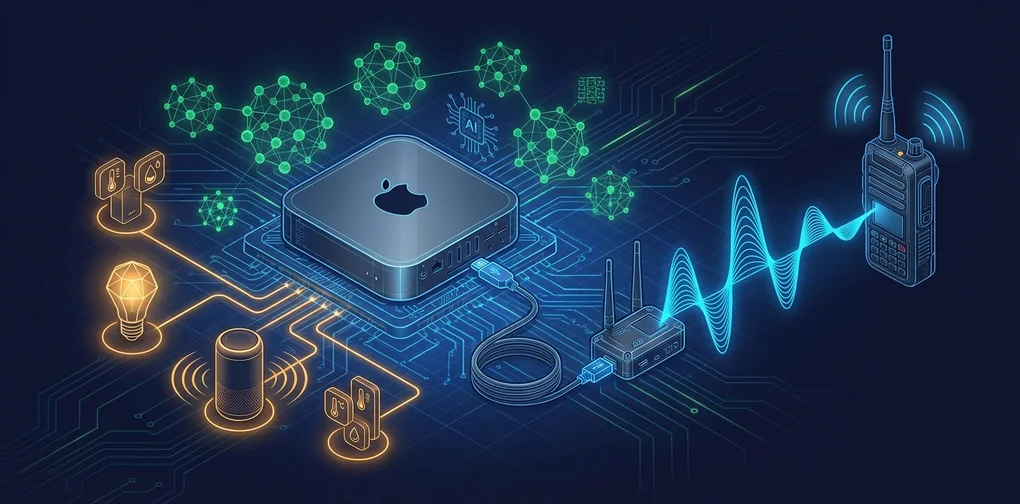

仅凭Mac mini和30美元的LoRa收音机,在没有互联网的情况下实现语音控制和智能家居操作的实战案例分析。深入探讨本地AI×IoT的具体实现与成本。

概述

当互联网中断时,智能家居就会瘫痪。基于云的语音助手和IoT自动化全部失效。然而,仅凭30美元的LoRa收音机和在Mac mini上运行的本地LLM,就有人实现了完全离线的智能家居。

一位居住在乌克兰的开发者,在战争导致频繁停电和互联网中断的情况下,将Meshtastic LoRa收音机与Ollama本地模型结合,构建了零互联网环境的智能家居控制系统。

本文将分析该项目的架构、技术栈、实现成本以及边缘AI的实用可能性。

系统架构

整体系统简单得令人惊讶。

graph TD

A[T-Echo 便携收音机] -->|LoRa 433MHz<br/>加密| B[T-Echo USB → Mac mini]

B --> C{消息路由}

C -->|SAY: 前缀| D[Home Assistant TTS → 音箱]

C -->|AI: 前缀| E[phi4-mini 分类器 → gemma3:12b]

C -->|状态查询| F[Home Assistant 传感器]

C -->|在线?| G[Discord → 云端AI]

C -->|离线?| H[Ollama 本地模型]

I[Outbox文件夹] -->|自动发送| A核心是双路由机制。有互联网时利用云端AI,没有时自动切换到本地模型。用户无需感知差异。

核心技术栈

LoRa通信 — Meshtastic + Lilygo T-Echo

Meshtastic是开源的LoRa网状网络固件。由于每个节点都能中继消息,部署多台设备可以构建数公里范围的通信网络。

- 硬件:Lilygo T-Echo(约30美元)

- 频率:433MHz LoRa

- 特点:加密频道、USB连接、网状中继

- 限制:每条消息200字符限制(通过AI响应自动分块解决)

本地LLM — Ollama

离线AI的核心是两阶段模型架构。

| 模型 | 角色 | 大小 | 用途 |

|---|---|---|---|

| phi4-mini | 意图分类器 | ~2B | 判别”智能家居命令还是提问?“ |

| gemma3:12b | 响应生成 | 12B | 实际回答与推理 |

先用轻量模型分类意图,仅在需要时调用大模型,这种结构使Mac mini M4 16GB也能实现实时响应。

Home Assistant集成

智能家居控制和TTS(文本转语音)由Home Assistant负责。

- 灯光控制、传感器读取、在室确认

- SAY: 前缀将收音机发送的文本转换为家中音箱的语音输出

- 支持乌克兰语TTS

SAY: Привіт, я скоро буду вдома

→ 无线电波 → Mac mini → HA TTS → 音箱播放语音这是完全不需要互联网连接的完全离线语音消息系统。

实现成本分析

这套系统最大的魅力在于成本。

| 项目 | 价格 | 备注 |

|---|---|---|

| Lilygo T-Echo × 2 | 约60美元 | 基站 + 便携 |

| Mac mini M4 16GB | 约500美元 | 已有则为0美元 |

| Home Assistant | 免费 | 开源 |

| Ollama + 模型 | 免费 | 开源 |

| Meshtastic固件 | 免费 | 开源 |

| HA Voice PE音箱 | 约50美元 | TTS输出用 |

| 总追加成本 | 约110美元 | 已有Mac mini时 |

无需云端AI服务的月度订阅费,一次性110美元投资即可完成完整的离线AI智能家居。

边缘AI的实践教训

1. 离线优先设计的价值

这个项目诞生于战争的极端环境,但离线优先设计的价值是普遍的。

- 灾害场景:地震、台风、停电时确保通信独立性

- 隐私:语音数据不会发送到云端

- 延迟:本地处理提升响应速度

- 成本:零月度订阅费

2. 小模型的战略性运用

将phi4-mini(2B)作为路由器、gemma3:12b作为执行器的分离架构,是在边缘设备上利用LLM的典范模式。

graph LR

A[用户消息] --> B[phi4-mini<br/>意图分类]

B -->|智能家居命令| C[Home Assistant API]

B -->|一般问题| D[gemma3:12b<br/>响应生成]

B -->|TTS请求| E[HA TTS → 音箱]3. 网状网络的扩展可能性

由于Meshtastic是网状协议,添加节点即可扩展通信范围。原作者构想的社区规模AI网络是一个现实可行的方案。

- 每个节点搭载本地LLM

- 网状中继覆盖数公里范围

- 无需互联网的社区AI基础设施

自行实现指南

以下是复现此系统的最低要求。

- 硬件准备:Lilygo T-Echo 2台、Mac mini(或任意Apple Silicon Mac)、HA兼容音箱

- 软件安装:Meshtastic固件、Ollama、Home Assistant

- 模型下载:

ollama pull phi4-mini、ollama pull gemma3:12b - 监听守护进程:通过Meshtastic CLI连接USB收音机,用Python守护进程实现消息路由

- HA集成:通过REST API或WebSocket控制Home Assistant

整套技术栈均为开源,可以自行编写代码或委托AI编程工具完成。

结论

30美元收音机 + 本地AI = 无需互联网的智能家居。这个等式虽然简单,却清楚地展示了边缘AI的实用未来。

不依赖云端的AI系统已不再是理论。只要有16GB内存的Mac mini和30美元的收音机,今天就能实现。随着本地LLM性能的持续提升,边缘AI × IoT的组合将成为最具实用性的AI应用领域之一。

参考资料

阅读其他语言版本

- 🇰🇷 한국어

- 🇯🇵 日本語

- 🇺🇸 English

- 🇨🇳 中文(当前页面)

这篇文章有帮助吗?

您的支持能帮助我创作更好的内容。请我喝杯咖啡吧!☕