Dapr Agents v1.0 GA — AIエージェントをKubernetes上で落ちないようにする方法

KubeCon Europe 2026で発表されたDapr Agents v1.0のdurable workflow、自動復旧、scale-to-zeroを分析し、既存エージェントフレームワークとの違いを掘り下げます。

昨日、KubeCon Europe 2026アムステルダムでDapr Agents v1.0 GAが発表されました。

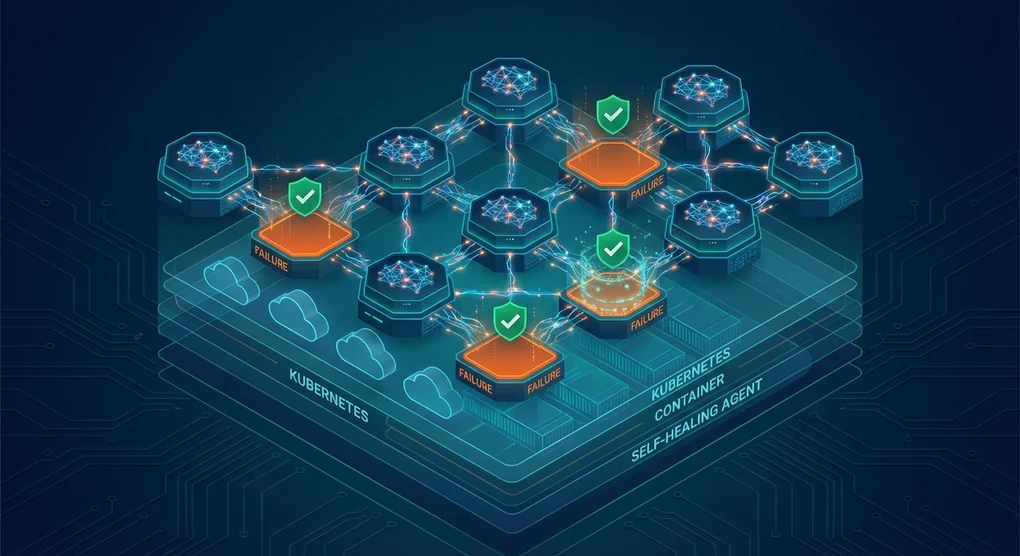

正直なところ、最初にこのニュースを聞いたとき「また新しいエージェントフレームワークか?」という思いが先に立ちました。LangGraph、CrewAI、AutoGen、OpenClaw — 今やエージェントフレームワークがいくつあるか数えること自体が無意味な時代です。ところがDapr Agentsの発表を詳しく見てみると、これはちょっと毛色が違います。エージェントの「知能」ではなく「生存」に焦点を当てています。 プロセスが死んでも、ノードが再起動しても、ネットワークが切れても、エージェントがやっていた作業をそのまま引き継ぐというのが核心です。

なぜまた別のフレームワークなのか

ほとんどのエージェントフレームワークはLLM呼び出しロジックに集中しています。プロンプトチェイニング、ツール呼び出し、マルチエージェント会話 — すべて「エージェントが何をするか」に対する答えです。しかしプロダクションでエージェントを運用した経験がある方なら、こんな場面に遭遇したことがあるのではないでしょうか。

- LLM API呼び出しの途中でタイムアウトが発生し、ワークフロー全体が失敗

- エージェントが3ステップ中2ステップまで処理したのに、Podが再起動して最初からやり直し

- エージェントを10個同時に起動するとメモリが溢れる

Dapr Agentsはこの問題をDaprランタイムのインフラビルディングブロックで解決します。CNCFプロジェクトであるDapr(GitHub 34K+スター)がすでにマイクロサービスで検証済みの分散システムパターン — ステートマネジメント、Pub/Sub、サービスインボケーション — をエージェントにそのまま適用したものです。

核心:Durable Agentとは何か

最も目を引くのはDurableAgentクラスです。一般的なエージェントと何が違うかというと、すべてのLLM呼び出しとツール実行がチェックポイントとして保存されます。ワークフローの途中でプロセスをkillしても、再起動すれば最後に保存された地点から再実行されます。

from dapr_agents import DurableAgent

from dapr_agents.workflow.runners import AgentRunner

weather_agent = DurableAgent(

name="WeatherAgent",

role="Weather Assistant",

instructions=["Help users with weather information"],

tools=[get_weather],

llm=DaprChatClient(component_name="llm-provider"),

)

runner = AgentRunner()

runner.serve(weather_agent, port=8001)これをDapr CLIで実行すると:

dapr run --app-id weather-agent --app-port 8001 \

--resources-path ./components -- python agent.py内部的にはDaprのバーチャルアクターモデル上で動作します。各エージェントが1つのアクターとして表現され、アクターはスレッドセーフでありながら分散環境で自動的に配置されます。数千のエージェントを単一マシンで動かすことも、Kubernetesクラスタに分散させることもできます。

私はこのアプローチがかなり合理的だと考えています。エージェントフレームワークが独自に分散システムを再発明する代わりに、すでに検証済みのインフラの上に載せるわけですから。LangGraphがカスタムチェックポインティングを実装し、CrewAIが独自のメモリシステムを構築する一方で、Dapr AgentsはRedisでもPostgreSQLでもDynamoDBでも — すでに運用中の30以上のデータベースをステートストアとしてそのまま差し込めます。

Scale-to-Zeroとパフォーマンス

バーチャルアクターモデルの最も魅力的な部分はscale-to-zeroです。エージェントがアイドル状態のときにメモリから降ろされますが、状態は維持されます。再度呼び出せば数ミリ秒でアクティベートされます。Diagridのベンチマークによると、アクターのアクティベーションレイテンシはtp90で約3ms、tp99で約6.2msです。

既存のフレームワークでエージェント100個を常時待機させようとするとメモリを大量に消費しますが、Dapr Agentsではリクエストが来たときだけアクティベートされ、終わったら消えます。サーバーレスファンクションのように動作しながらも、状態を失わないのです。

では、フレームワーク選択はどうすべきか

| Dapr Agents | LangGraph | CrewAI | |

|---|---|---|---|

| 核心的な強み | インフラ耐久性 | 複雑なワークフローグラフ | ロールベースのチーム構成 |

| 障害復旧 | 自動(durable workflow) | 手動チェックポインティング | 限定的 |

| Kubernetes | ネイティブ(サイドカー) | 別途構成 | 別途構成 |

| スケーリング | Scale-to-zero、自動 | 手動 | 手動 |

| 状態管理 | 30+ DBプラグイン | インメモリ/カスタム | インメモリ |

| 学習コスト | 中程度(Daprの知識が必要) | 高い(グラフ理論) | 低い |

| 言語 | Pythonのみ | Python | Python |

正直に言えば、Dapr Agentsは万能ではありません。

Pythonしかサポートしていません。 v1.0なのにC#やJava SDKがまだありません。エンタープライズでJVMベースのシステムを運用しているチームであれば、すぐに導入するのは難しいでしょう。GitHubスターも630程度で、コミュニティはまだ小さいです。LangGraphやCrewAIのエコシステムと比較すると、プラグインやサンプルが不足しています。

そしてDaprランタイムに依存するというのは諸刃の剣です。Daprをすでに使っているチームであれば、エージェントを自然に既存インフラに統合できます。しかしDaprを初めて触るチームであれば、エージェント1つ立ち上げるためにサイドカーアーキテクチャ、コンポーネントYAML、Dapr CLIまで学習しなければなりません。「エージェントロジック10行+インフラ設定100行」のような状況が十分にあり得ます。

個人的な見解

私はDapr Agentsが「エージェントフレームワーク戦争」において独自のポジションを確立したと考えています。ほとんどのフレームワークが「より賢いエージェント」を作ることに集中する中、Dapr Agentsは「落ちないエージェント」を作ることに集中しています。これはプロダクションでエージェントを実際に運用した経験のあるチームなら共感できる方向性でしょう。

ZEISSがKubeConのキーノートでDapr Agentsを用いて光学パラメータ文書の抽出を実装した事例を発表したことも印象的です。実際のビジネスクリティカルなワークロードにおいて、エージェントが「落ちない」ことがいかに重要かを示しています。

ただし、現時点で導入を検討するなら、2つの条件が揃っている必要があります。第一に、チームがすでにKubernetesを運用していること。第二に、エージェントが「1回実行して終わり」ではなく、長時間実行されるデュラブルなワークフローを必要としていること。シンプルなRAGパイプラインや1回限りのツール呼び出しであれば、LangGraphやCrewAIのほうがはるかに軽量です。

CNCFの公式サポートであるという点、そしてDaprという検証済みのランタイムの上に構築されているという点 — この2つが長期的にDapr Agentsの最大の競争力になると考えています。エージェントフレームワークは溢れていますが、クラウドネイティブなエージェントランタイムはまだこれだけです。

他の言語で読む

- 🇰🇷 한국어

- 🇯🇵 日本語(現在のページ)

- 🇺🇸 English

- 🇨🇳 中文

この記事は役に立ちましたか?

より良いコンテンツを作成するための力になります。コーヒー一杯で応援してください!☕