Meta Llama 4 全面解析 — Maverick·Scout开源AI如何改变企业AI战略

深入分析Meta Llama 4 Maverick(400B MoE)与Scout(10M上下文)的架构、基准测试和成本结构,从CTO/工程总监视角探讨企业应如何重新定义开源AI战略。

Meta正式发布了Llama 4。两个立即可用的模型——Maverick和Scout——以及仍在训练中的超大型模型Behemoth(2万亿参数)的预告,这次发布绝非简单的模型更新。这是开源AI真正追上前沿商业模型的转折点。了解这一发布的竞争背景,可先参阅2026年2月AI模型大爆发。作为工程总监或CTO,我们来理清这一发布意味着什么。

Meta正式发布了Llama 4。两个立即可用的模型——Maverick和Scout——以及仍在训练中的超大型模型Behemoth(2万亿参数)的预告,这次发布绝非简单的模型更新。这是开源AI真正追上前沿商业模型的转折点。了解这一发布的竞争背景,可先参阅2026年2月AI模型大爆发。作为工程总监或CTO,我们来理清这一发布意味着什么。

Llama 4的两个模型:Scout与Maverick

Llama 4 Scout

Scout可以简单概括为”拥有超长记忆的高效模型”。

- 激活参数:17B(MoE架构,16个专家)

- 总参数:109B

- 上下文窗口:业界最大 10M tokens

- 硬件需求:单张NVIDIA H100 GPU即可运行

- 多模态:原生支持文本+图像

10M token的上下文不只是数字大而已。GPT-4o的128K上下文让它几乎无法一次性读取由数百个文件组成的大型代码库。而Scout可以将中等规模项目的全部代码作为输入。在”大海捞针”测试中,Scout在8M token范围内保持95%以上的检索准确率,在完整10M限制下降至89%。

Llama 4 Maverick

Maverick是性能极致的旗舰模型。

- 激活参数:17B(MoE,128个专家)

- 总参数:400B

- 定位:在编码和多模态方面超越GPT-4o,推理性能与DeepSeek v3相当

- 推理成本:$0.19〜$0.49/百万tokens(约为GPT-4o的1/9)

得益于MoE(混合专家)架构,尽管总参数量达400B,但每次token处理时只有17B参数被激活。这意味着以小模型的成本实现了大模型级别的性能,这才是核心所在。

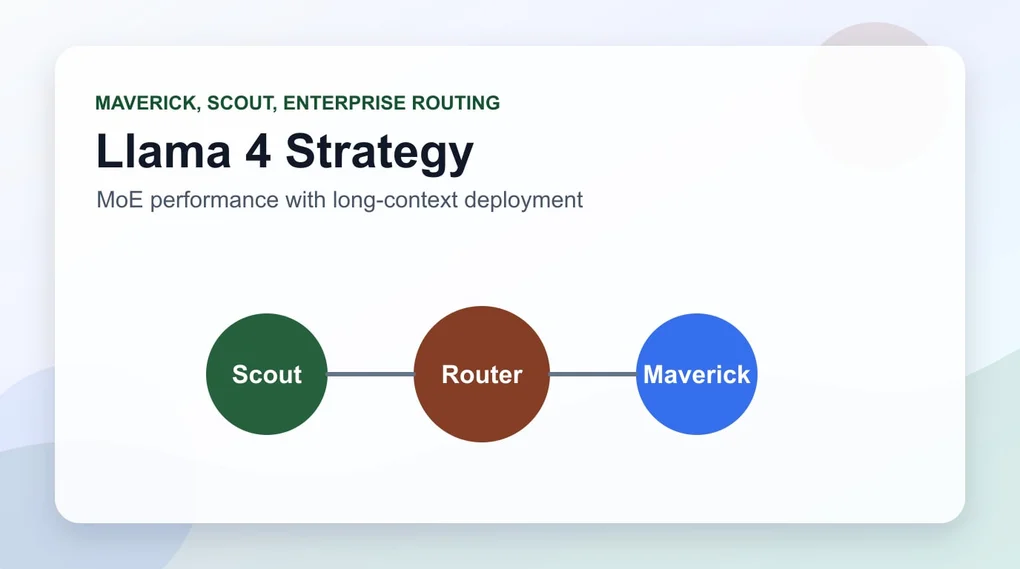

为什么架构至关重要:MoE的本质

传统LLM采用”Dense”(密集)结构——所有参数参与每一个token的计算。而混合专家架构则维护多个专家子网络(experts),根据输入只激活其中一部分。

Dense模型:

输入token → [全部400B参数激活] → 输出

MoE模型(Maverick):

输入token → [路由器:选择最优专家] → [仅激活17B] → 输出

↑ 从128个专家中选择这一架构的优势如下:

- 降低推理成本:激活参数少,FLOPs更低

- 专业化:每个专家可以专注特定类型的处理

- 可扩展性:总参数增加,但推理成本不会线性增长

自DeepSeek用MoE架构震撼市场以来,Meta也选择了相同的方向。

基准测试:实际水平如何

根据Meta公布的基准测试,Maverick达到了以下水平:

编码:与GPT-5.3持平或部分领先

推理:与GPT-5.3相差1〜2个百分点(MMLU-Pro、GPQA Diamond、MATH)

多模态:全面超越GPT-4o

Scout在推理性能上比Maverick低8〜12个百分点,但在编码辅助和长文档处理方面仍具有足够的竞争力。

值得注意的是,基准测试只是参考指标。在实际生产环境中,延迟、上下文管理和微调能力等因素往往更为重要。

成本对比:企业视角

以下是主要模型推理成本比较(输入输出混合基准,API单价):

| 模型 | 约成本/百万tokens |

|---|---|

| GPT-4o | $2.5〜$10 |

| Claude Sonnet 4.5 | $3〜$15 |

| Llama 4 Maverick | $0.19〜$0.49 |

| Llama 4 Scout | $0.10〜$0.20 |

对于每月处理1亿tokens的企业而言,从GPT-4o切换到Maverick可节省数百万元人民币的年度成本。AI Agent成本vs人力成本的现实分析提供了AI运营成本结构的详细框架,可以对照参考。

当然,这并不意味着简单的”成本替代”。模型选择需要综合考虑任务特性、质量要求和基础设施能力。

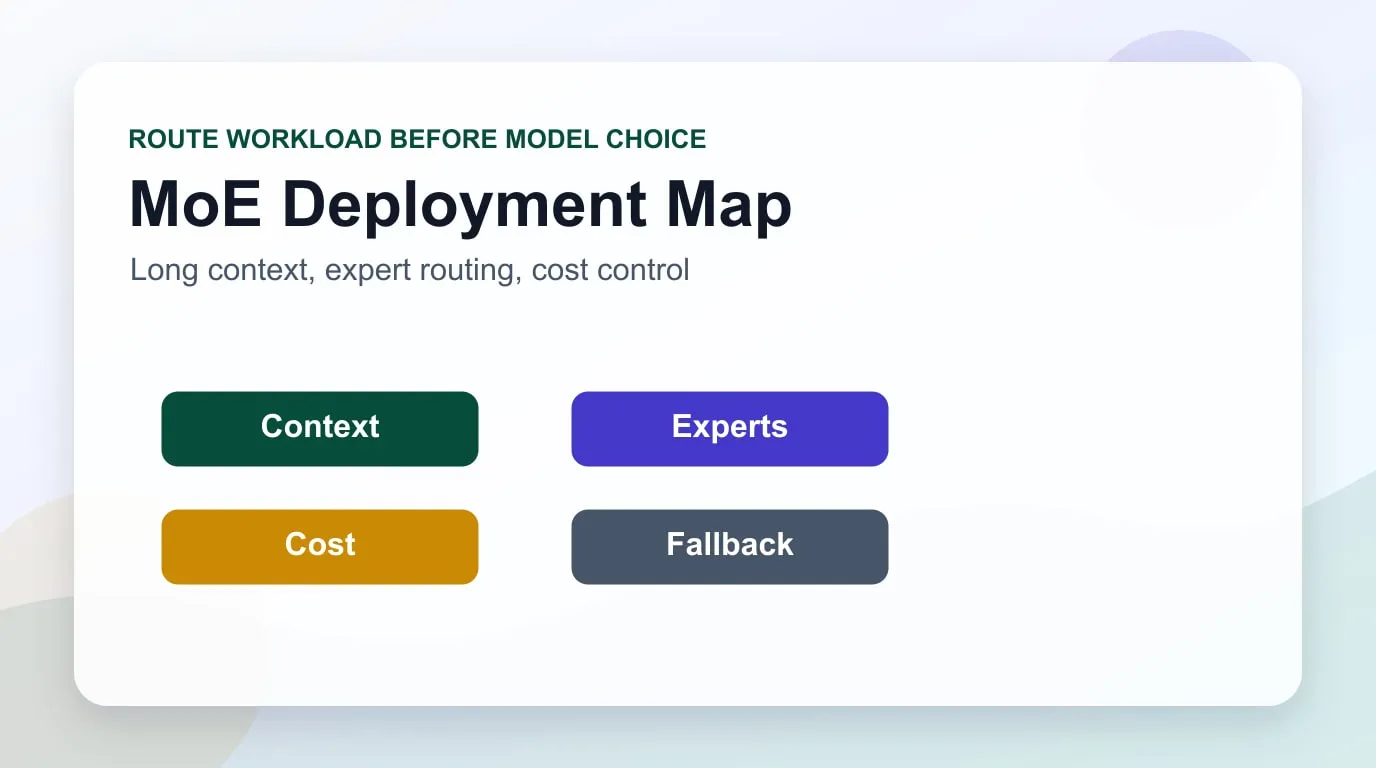

工程负责人需要考虑的战略框架

1. 任务分层(Task Segmentation)

对所有AI请求使用同一模型是一种浪费。按复杂度和成本容忍度路由任务才是明智之举。

Tier 1 — 复杂推理/创意工作

→ Claude Opus 4、GPT-5.2等前沿模型

Tier 2 — 通用编码/分析/文档撰写

→ Llama 4 Maverick(高性价比,高性能)

Tier 3 — 大批量处理/简单分类/日志分析

→ Llama 4 Scout(超低成本,超长上下文)2. 数据主权战略

两个模型均支持自托管。通过与IBM和Dell的合作,Fortune 500企业已开始进行本地化部署。

处理内部代码库、客户数据或财务数据时,将数据发送到外部API本身就是一种风险。在这类使用场景中,自托管开源LLM在合规性和安全性方面具有明显优势。同一主题下,GLM-5:MIT许可证前沿模型与企业战略也值得对比参考。

3. 摆脱供应商依赖

当前Anthropic被美国国防部列为供应链风险,这清楚地表明将AI基础设施依赖于单一供应商的风险有多大。OpenAI、Anthropic、Google各自政策变化对企业的影响不可预测。维持开源LLM能力是对冲这一风险的重要手段。

4. 通过微调实现领域专业化

Scout可以使用LoRA适配器在20GB显存以下的环境中进行微调。这使得构建基于企业内部知识库的专业化模型成为可能——这是仅能通过API访问商业模型所无法实现的。

实际应用场景

场景A:大规模代码库分析

正在推进遗留系统迁移项目?利用Scout的10M token上下文,将整个代码库一次性输入,自动化依赖分析、重构建议和文档生成。

场景B:成本优化处理管道

客户咨询分类、日志异常检测、内容审核等大批量、低复杂度任务,Maverick或Scout完全胜任。在实际生产请求中,真正需要GPT-5.2的可能不足10%。

场景C:私有AI助手

在金融、法律或医疗领域,数据离开本地环境本身就是问题。将Llama 4部署于本地,即可构建具有完整数据主权、性能接近Claude/GPT的内部AI助手。

Behemoth:下一步预告

Meta还预告了2万亿参数(总参数基准)的Behemoth,目前仍在训练中。当前的Maverick和Scout均是从Behemoth蒸馏而来。Behemoth发布后,开源AI的上限将再次提升。

结论:开源AI已成战略支柱

Llama 4的出现传达了几个明确信号。

第一,前沿级性能已可在开源中实现。可选方案的质量已发生根本性变化。

第二,AI基础设施的经济学需要重新计算。旧有的成本假设已不再成立。

第三,数据主权和供应商独立性在技术上变得更易实现。障碍已大幅降低。

作为工程团队负责人,现在是将开源LLM能力内化的最佳时机。短期从试点项目起步,中期建立任务分层体系,长期通过领域专业化微调构建竞争优势。

开源AI不再是”次优选择”,它已成为战略选项的重要一极。

参考资料:Meta AI官方博客、Llama 4官方页面、Hugging Face Llama 4发布、VentureBeat

阅读其他语言版本

- 🇰🇷 한국어

- 🇯🇵 日本語

- 🇺🇸 English

- 🇨🇳 中文(当前页面)

这篇文章有帮助吗?

您的支持能帮助我创作更好的内容。请我喝杯咖啡吧。