Hindsight——赋予AI智能体学习记忆的开源MCP内存系统

开源MCP内存系统Hindsight赋予AI智能体真正的学习记忆能力,在LongMemEval基准测试中达到91.4%。本文深入解析三层记忆架构、Retain·Recall·Reflect核心操作、Mental Model自动形成机制,以及基于Docker实现5分钟快速部署的生产落地策略。

AI智能体的记忆难题

作为将AI智能体部署到生产环境的Engineering Manager,你一定遇到过这样的场景:当你说”还记得昨天讨论的内容吗?“,智能体却一脸茫然。对话结束后所有上下文消失殆尽,下一次会话又得从头开始。

虽然有很多尝试通过RAG(Retrieval-Augmented Generation)或简单的向量数据库来解决这个问题,但大多数只停留在”检索”层面,未能进阶到”学习”。单纯搜索过往对话,与从经验中提取模式并形成mental model,本质上是完全不同的。

Hindsight正是一个正面挑战这一难题的开源项目。它兼容MCP(Model Context Protocol),可与Claude、Cursor、VS Code等主流AI工具即时集成,并在LongMemEval基准测试中达到91.4%,成为智能体记忆系统中首个突破90%大关的方案。

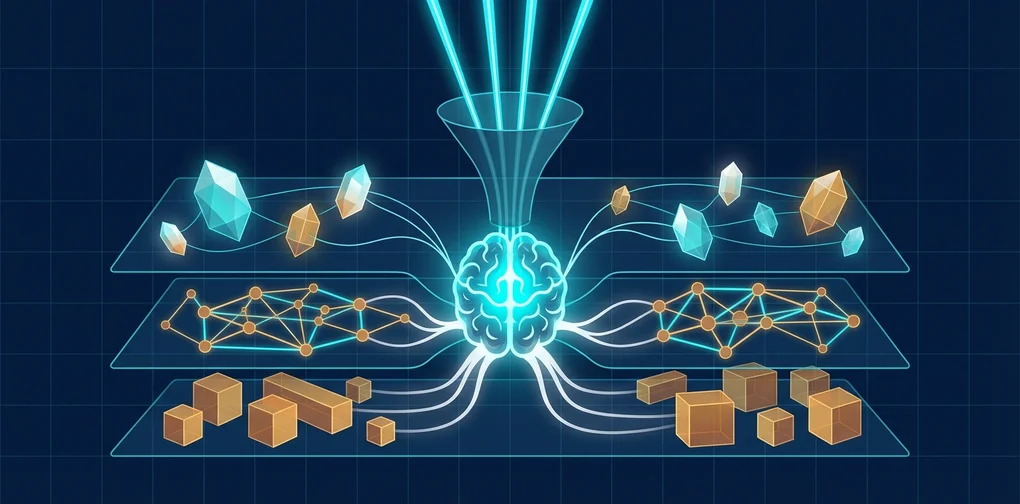

Hindsight的架构

Hindsight采用受人类认知结构启发的仿生(biomimetic)数据结构来组织记忆。

graph TD

subgraph 记忆类型

W["World<br/>关于环境的事实"] ~~~ E["Experiences<br/>智能体的交互记录"]

end

subgraph 处理层级

F["Fact Extraction<br/>事实提取"]

ER["Entity Resolution<br/>实体消解"]

KG["Knowledge Graph<br/>知识图谱"]

end

subgraph 高阶认知

MM["Mental Models<br/>学习形成的理解"]

end

W --> F

E --> F

F --> ER

ER --> KG

KG --> MM记忆大致分为三个层级:

- World:关于环境的事实(“炉子是烫的”)

- Experiences:智能体自身的交互记录(“我碰了炉子,发现是烫的”)

- Mental Models:通过对原始记忆进行反思(reflect)而形成的学习性理解

与传统RAG系统的核心差异正在于这个Mental Models。它不只是存储和检索数据,而是分析记忆、形成模式,构建出让智能体”从经验中学习”的结构。

三大核心操作

Retain —— 记忆存储

from hindsight_client import Hindsight

client = Hindsight(base_url="http://localhost:8888")

# 不是简单文本,而是以结构化记忆形式存储

client.retain(

bank_id="project-alpha",

content="김 팀장이 Sprint 23에서 인증 모듈 리팩토링을 완료했다. "

"기존 세션 기반에서 JWT로 전환했으며, 응답 시간이 40% 개선되었다.",

context="sprint-retrospective",

timestamp="2026-03-15T10:00:00Z"

)仅通过这一次调用,Hindsight内部会执行以下操作:

- 实体提取:“金组长”、“Sprint 23”、“认证模块”

- 关系映射:“金组长 → 完成 → 认证模块重构”

- 事实归一化:“Session → JWT迁移”、“响应时间提升40%”

- 时间索引:记录为2026-03-15发生的事件

- 生成向量嵌入并更新知识图谱

Recall —— 记忆检索

graph TD

Q["Query"] --> S["Semantic<br/>向量相似度"]

Q --> K["Keyword<br/>BM25匹配"]

Q --> G["Graph<br/>实体/因果链接"]

Q --> T["Temporal<br/>时间范围过滤"]

S --> RRF["Reciprocal Rank<br/>Fusion"]

K --> RRF

G --> RRF

T --> RRF

RRF --> CE["Cross-Encoder<br/>Reranking"]

CE --> R["最终结果"]result = client.recall(

bank_id="project-alpha",

query="인증 관련 최근 변경 사항은?",

max_tokens=4096

)Reflect —— 反思与学习

insight = client.reflect(

bank_id="project-alpha",

query="우리 팀의 스프린트 회고에서 반복되는 패턴이 있나?",

)MCP集成:5分钟快速上手

安装与启动

export OPENAI_API_KEY=sk-xxx

docker run --rm -it --pull always \

-p 8888:8888 -p 9999:9999 \

-e HINDSIGHT_API_LLM_API_KEY=$OPENAI_API_KEY \

-v $HOME/.hindsight-docker:/home/hindsight/.pg0 \

ghcr.io/vectorize-io/hindsight:latestMCP客户端配置

{

"mcpServers": {

"hindsight": {

"type": "http",

"url": "http://localhost:8888/mcp/my-project/"

}

}

}支持的LLM提供商

| 提供商 | 配置值 | 备注 |

|---|---|---|

| OpenAI | openai | 默认值 |

| Anthropic | anthropic | Claude |

gemini | Gemini | |

| Groq | groq | 快速推理 |

| Ollama | ollama | 本地部署 |

| LM Studio | lmstudio | 本地部署 |

Engineering Manager视角的落地策略

第一阶段:从个人智能体开始

第二阶段:构建团队共享记忆

graph TD

subgraph 各成员智能体

A["开发者A<br/>智能体"] ~~~ B["开发者B<br/>智能体"] ~~~ C["开发者C<br/>智能体"]

end

subgraph Hindsight服务器

P["team-project<br/>bank"]

S["sprint-retro<br/>bank"]

D["decisions<br/>bank"]

end

A --> P

B --> P

C --> P

A --> S

B --> S

C --> S按用途分离bank:

- team-project:代码库、架构决策、技术栈

- sprint-retro:Sprint回顾、速度指标

- decisions:ADR、技术选型依据

第三阶段:运维监控

实战应用场景

场景1:加速新人入职

场景2:Sprint回顾自动分析

场景3:技术决策追踪

与现有方案的对比

| 特性 | 简单向量DB | RAG | Knowledge Graph | Hindsight |

|---|---|---|---|---|

| 存储 | 仅嵌入向量 | 文档分块 + 嵌入 | 实体 + 关系 | 事实 + 实体 + 时序 + 向量 |

| 检索 | 仅向量相似度 | 向量 + 关键词 | 图遍历 | 四路并行检索 + 重排序 |

| 学习 | 无 | 无 | 有限 | Mental Model自动形成 |

| 时间感知 | 无 | 有限 | 有限 | 原生时间索引 |

| 基准测试 | - | - | - | LongMemEval 91.4% |

注意事项

- 处理延迟:retain后立即recall,处理可能尚未完成。

- LLM成本:内部处理需要额外的LLM调用。

- 数据安全:记忆中可能包含敏感信息。

- Mental Model质量:自动生成的mental model并非总是准确的。

结论

Hindsight是在AI智能体记忆领域展现出重要进展的项目。它采用MIT许可证的开源方案,通过一个Docker容器即可在5分钟内快速上手。

参考资料

阅读其他语言版本

- 🇰🇷 한국어

- 🇯🇵 日本語

- 🇺🇸 English

- 🇨🇳 中文(当前页面)

这篇文章有帮助吗?

您的支持能帮助我创作更好的内容。请我喝杯咖啡吧。